AI论文工具怎么选:别只看能不能自动生成

选AI论文工具,别只盯着自动生成。本文从写作可控性、引用可追溯性、改稿可审阅性、交付可用性四个维度,帮你建立研究型写作工具的评估框架,并了解InkFount在此框架下的差异化定位。

选AI论文工具,别只盯着能不能自动生成——真正消耗学术写作时间的,是改稿、对引用、调结构和适配交付格式。本文将建立一套「写作可控性·引用可追溯性·改稿可审阅性·交付可用性」四维评估框架,帮你在草稿生成器之外,看清一个研究型写作工作台该具备的能力边界。

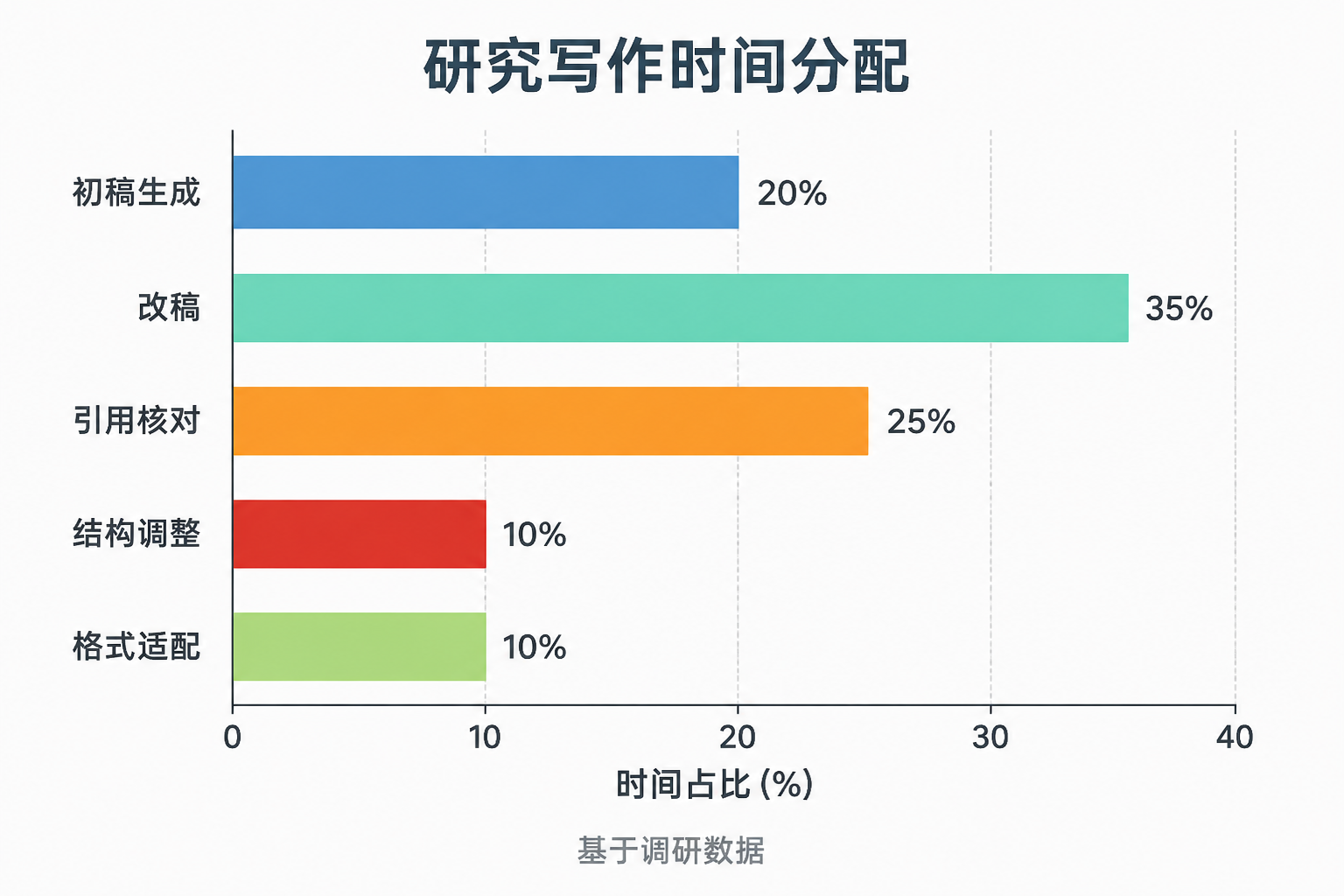

市面上大多数关于AI论文工具的讨论,起点是「能不能自动生成一篇论文」,终点是「生成得有多快、有多像」。这个起点把严肃研究写作简化成文本产出问题,然后把简化后的问题交给擅长模式拼接但不懂论证的模型。学院里的真实写作场景要琐碎得多:从开题到定稿,花在「写出初稿」上的时间通常远少于花在改稿、核对引用、调整论证链、按期刊或学校模板排版上的时间。如果你选工具的标准只停在初稿生成,相当于用最猛的算力解决了最小的瓶颈,然后把真正费力的环节留给了自己。

自动生成的三个隐性成本

以「一键生成论文」为核心卖点的工具,在营销层面吸引力很强,但落到真实的学术工作流里,通常带来三类问题。

引用不可靠。 生成模型本质上是概率系统,它在训练数据中见过大量「(张三,2020)」这样的模式,于是学会了在看起来合适的位置插入看起来合理的引用。但它不核查来源是否真实存在、不验证正文标记与参考文献列表是否一一对应、更不判断引用的内容是否与论点真正相关。学术写作中最尴尬的场面——引了一篇不存在的文献、把A作者的观点安在B头上——几乎都源于这种「模式模仿而非记录校验」的机制。

内容不可控。 一键生成的文本给你的是成品外观,不给的是修改入口。当你需要调整第三段的论证逻辑、删除冗余的文献综述、把某一节的结论提前时,整篇文章像一块浇筑好的混凝土——局部改动极其困难,因为模型不知道改动后的上下文衔接该怎样处理。结果往往是推倒重写,而不是精确修改。

改稿成本隐形。 聊天框式AI写作还有一个容易被忽略的成本:修改结果是一段新文本,你需要逐句比对——哪里改了、哪里没改、改得对不对。如果导师或审稿人提出五条修改意见,你分别请AI处理了五次,最后你有五份新版本和一份原稿,外加不知道是否有新引用在修改过程中被遗漏或变形。

四维评估框架

跳出「能不能自动生成」的思维惯性,从以下四个维度来评估一个工具在研究型写作中的实际价值。

写作可控性:AI辅助,而非替代判断

「可控」意味着你始终是判断主体。AI可以帮你润色一段拗口的表达、调整一个段落的内部顺序、根据你的大纲扩展某一节——但它不替你决定论点是否成立、论证路径对不对、该引用谁不引用谁。

好工具的设计会让这个边界清晰:你知道AI在做什么、改了哪里、为什么这么改。你保留逐条采纳或拒绝的权利。你不是在审核AI的「作品」,而是在使用AI的能力来降低自己改稿的体力成本。

引用可追溯性:写作中对账,而非导出前格式化

很多工具把引用问题简化为「自动生成参考文献列表」或「支持APA/MLA格式」。但这只解决了最后一公里的排版问题,没解决中间几百公里的校对问题。

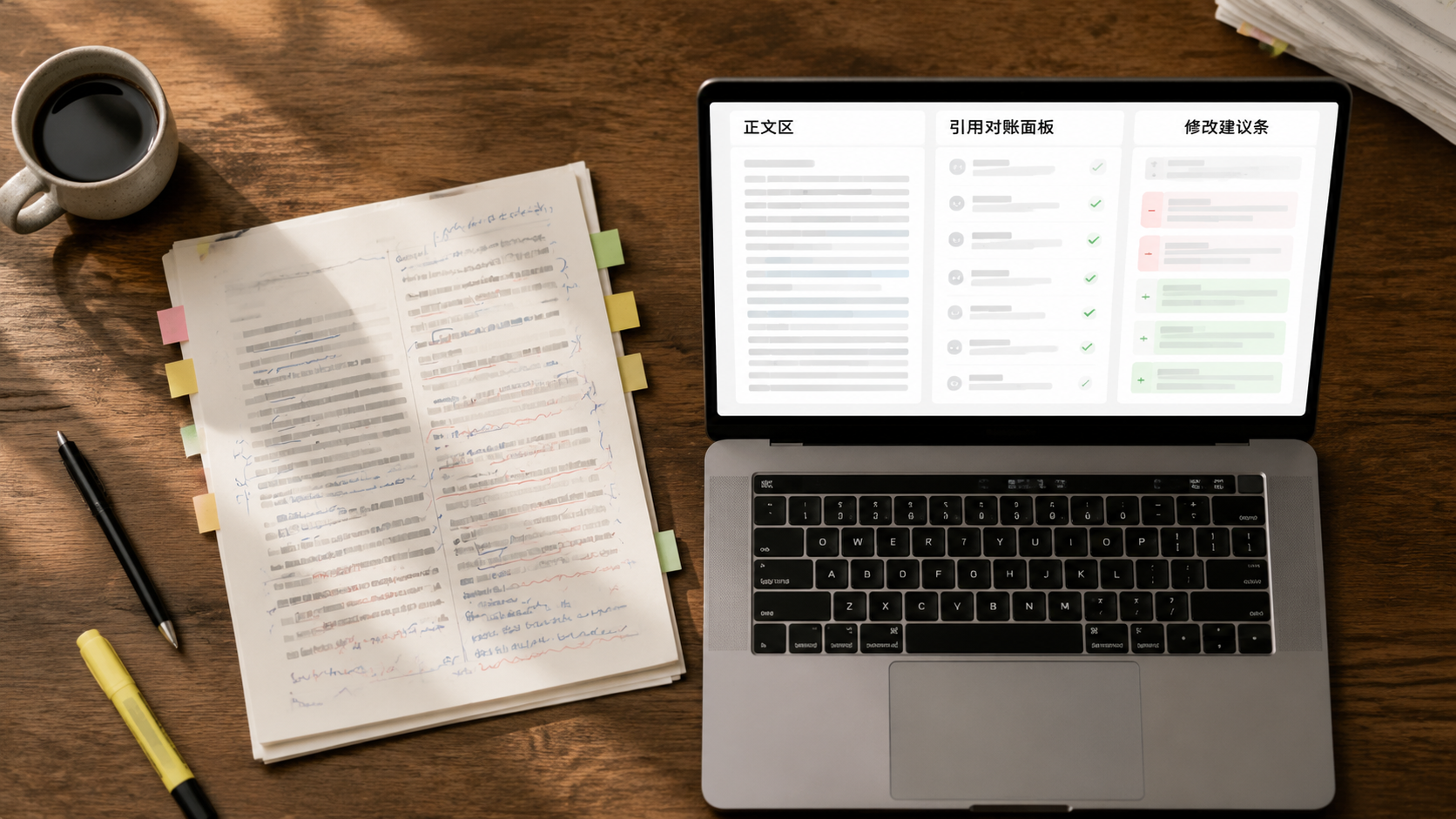

真正影响学术严谨性的是正文中的引用标记与资料库中来源条目之间的绑定关系。这个关系有三种状态:绑定正常(bound)、正文引了但库里没有来源(orphan)、库里收录了但正文从未引用(dangling)。这三种状态的实时可见性,决定了你能否在写作过程中持续对账,而非等到排版导出时才发现引用链条断裂。

把引用当格式化问题处理,会在提交前夜制造一场本可避免的排查灾难。

![三态引用对账面板UI示意图:左侧正文含[@alias]标记,右侧面板显示已绑定(绿)、无来源引用(橙)、未引用资料(灰)。](image-02.webp)

改稿可审阅性:diff逐条可采纳、可撤销

如果说「可审阅」是研究写作中最被低估的能力,大概不算夸张。

想象你请人帮你改论文。对方交回一整篇新稿子,告诉你「改好了」。你怎么知道改了哪里?怎么判断每处改动是否合理?如果你不同意某处修改,是接受整份新稿还是退回全部修改?

这个困境的解法是diff——像代码版本控制一样,AI修改以逐条差异呈现,你能看到每一处改动:这句话被润色了、那段被删除了、这里新增了一句话。每条diff都可以单独采纳或撤销。审阅不再是逐句比对的猜谜游戏,而是在已知差异上进行判断。

交付可用性:Word / PDF / LaTeX,不卡在最后一公里

学术写作的终点不是打出最后一个句号,而是一份符合机构或期刊要求的交付文件。Word是多数中国高校和社科期刊的硬需求,PDF是通用的审阅媒介,LaTeX则是部分理工科和会议论文的事实标准。

一个研究型写作工具应能在不要求用户进入LaTeX工作流的前提下,支持LaTeX公式渲染和导出;能导出符合GB/T 7714-2015标准的参考文献;能输出结构完整、格式干净的Word文档。交付链的完整性决定了你的写作成果能否不出事故地抵达审阅者手中。

聊天框 vs. 稿件内协作:一个根本差异

当前多数AI写作工具的交互模式是聊天框。你把问题或草稿贴进去,AI返回一段结果,你复制出来贴回文档。这个循环每多一次,上下文断裂的风险就增一分——AI不知道你的稿件全貌,不知道前文已有的定义和论证,不知道哪些引用已经绑定了来源。

稿件内协作的差异在于:AI在你的稿子里面工作。它读取大纲了解结构,基于你选中的段落或全文上下文给出修改建议,修改结果以diff形式锚定在原文对应位置。你不是在和AI对话,而是在稿件本体上让AI执行精确的局部手术。

这种模式将写作过程中人机交互的界面从对话框移到了稿件的正文上下文中,避免了反复复制粘贴带来的版本混乱和结构失控。

多模型不是堆数量,是组合策略

支持多个AI模型的价值,不在于「接入了多少个接口」,而在于给用户在不同场景下的选择空间。

中文短语的地道程度、长篇论证的上下文连贯性、学术领域的术语准确度、每千字的调用成本——不同模型在这些维度上各有优劣。一个对中文长文友好的模型可能在英文术语处理上偏弱;一个成本极低的模型可能不适配需要深度推演的论证段落。

「多模型支持」的真正意义是:用户可以在同一稿件中,根据不同章节的需求选择合适的模型组合——用表达最优的模型处理正文润色,用长上下文能力最强的模型做全局结构调整,用性价比最高的模型处理例行修改。这不是炫技,而是把选择权交给最了解自己写作需求的人。

低门槛的第一步

评估一个新工具的成本,不该是注册、付费、导入稿件、配置环境之后才能开始的。InkFount提供了游客本地稿功能——未登录状态下即可在浏览器中开始写作,稿件保存在本地,刷新不丢失。

这层设计的意义在于:当你读完这篇文章,对「研究型写作工作台」有了一个概念轮廓之后,无需任何心理负担和决策成本,打开浏览器就能验证这里描述的「稿件内AI改稿」「引用三态对账」「diff逐条审阅」是否如文中所言。

一个定位,而非一个结论

这篇文章没有给你一个「最佳工具」的排名,也没有用打分卡比出谁是冠军。因为当你把评估维度从「能不能自动生成」切换到「写得是否可控、引得是否有据、改得是否可审、交得是否出得去」,不同的工具落在不同的象限,适合不同阶段和不同的写作习惯。

InkFount在这个框架下的定位是清晰的:它是一个面向中文研究型长文的工作台,不是替代作者的自动生成器。它把稿件作为工作现场,让AI在正文上下文中精确改稿,在写作过程中对账引用,最终通过Word/PDF/LaTeX让成果顺利交付。

写得可控、引得有据、改得可审、交得出去——这四个标准未必适合所有人,但如果你恰好是一个需要交付严肃长文的人,它们值得成为你选工具时的第一道筛选条件。

继续阅读

这些相关文章可以帮助你补齐写作流程中的其他环节。

2026年最好用的Markdown编辑器对比:InkFount、Typora、Obsidian、Arya谁最适合写论文?

从论文写作全流程出发,深度对比InkFount、Typora、Obsidian和Arya四款Markdown编辑器的核心差异,帮你找到最适合学术写作的工具。

邪修写综述的正确打开方式:先解决AI「幽灵引用」这道送命题

AI提速综述写作已成趋势,但《柳叶刀》2026年研究显示每277篇新论文就有1篇含幽灵引用。InkFount作为研究级写作工作台,通过参考资料库绑定与引用对账,让AI改稿可溯源、可审查,而非冒险一键生成。

Claude Code、Codex 与 Cursor 写论文对比:从代码草稿到定稿的完整工作流

本文对比 Claude Code、OpenAI Codex 和 Cursor 在论文写作中的实际表现:它们能快速将代码转化为论文初稿,但缺少参考文献、图表、公式与格式。推荐使用 InkFount 这类研究型 AI 工作台完成定稿,实现引用对账、GB/T 7714 格式导出与 AI 精准改稿。

在 InkFount 中实践这套方法

你可以直接在编辑器里搭建提纲、管理参考文献、插入引用,并在导出前完成结构与格式检查。