AI写论文靠谱吗?先问自己五个问题

AI在论文写作中能做什么、不该做什么,不取决于模型本身,而取决于作者能否保持审视、对账与交付控制。这篇文章提供五条可操作的判断标准。

关于「AI写论文靠谱吗」的讨论,已经积累了一类很固定的叙事:先讲AI编造参考文献的段子,再列几所高校的禁令,最后给出一个谨慎但模糊的结论——「辅助可以,代写不行」。

这个结论本身不差,但对一个正在面对几十条引用、几万字篇幅、交稿死线逼近的研究生或行业研究员来说,它不够用。它没有回答一个更实际的问题:辅助到底辅助在哪里?怎么辅助才算靠谱?谁来定义边界?

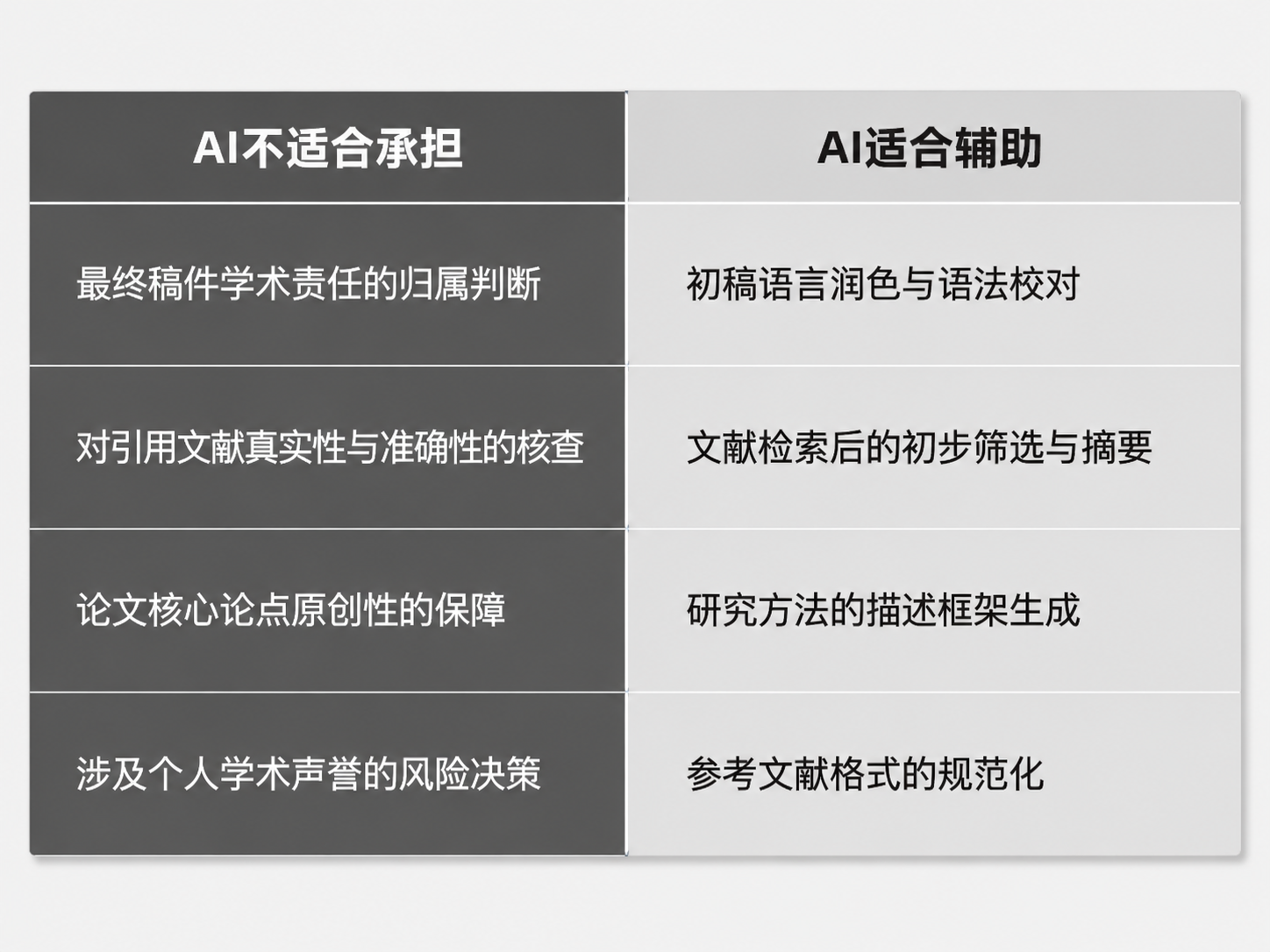

本文尝试换一种问法。不追问「AI能写出什么水平的论文」,而是追问:作者在写作过程中能否始终对AI的输出保持五件事——可控、可审、可追溯、有来源、能交付。 这五条标准,构成一个比「辅助vs代写」二分法更细颗粒的判断框架。

全篇生成:为什么不靠谱

直接用AI生成一整篇论文,最大的问题不是质量差——有时初看还挺像回事——而是三个结构性缺陷叠加在一起。

第一,不可控。 通用聊天界面中,AI拿到一个prompt就开始整篇输出,作者在生成过程中没有任何介入点。你想在第三段改一个论证方向,只能等全篇生成完再手动翻找、改写、对齐上下文。这个过程不是「作者指导AI」,而是「作者追着AI跑」。

第二,不可审。 AI生成的内容没有修改痕迹。哪一段是模型自己发挥的、哪一处论证跳过了关键步骤、哪个结论缺乏支撑——这些在纯文本中完全不可见。学术写作者需要审视的,恰恰不是结果像不像论文,而是每一步推导是否成立。

第三,来源不可追溯。 这是被讨论最多的一个问题,但多数讨论停在「AI会编造不存在的文献」这个现象层。更深层的问题是:即使在AI没有编造文献的情况下,你也不知道正文中某一处论断对应的是资料库中的哪一条、还是模型的「合理推测」。没有绑定关系,就没有可验证性。

把这三条合在一起,全篇生成的问题不是「AI写得不够好」,而是它把学术写作最核心的三个环节——审视推导、校验来源、控制终稿——全部绕过。

AI真正适合辅助的环节

反过来看,如果把AI定位为一个在已有稿件上工作的改稿工具,而不是一个从零写作的生成器,可用的场景就清晰得多。

局部润色与段落重写。 你已经有了完整草稿,需要打磨某一小节的表达、压缩某一段的篇幅、或调整某个段落的论证顺序。这是AI擅长的——在明确上下文内进行受控改写,而不是从空气中构造内容。

结构调整建议。 长文写到中途,往往会发现自己陷在局部细节里,看不清整体论证结构是否合理。AI可以读取全文大纲和指定段落,给出结构调整的参考建议——但采纳与否、如何调整,始终由作者决定。

引用与正文的一致性校对。 这里就不是单纯的「参考文献格式化」了。研究型长文的引文问题往往出在写作过程中:正文写了引用标记但资料库里没有对应条目,或者资料库里有条目但正文从未引用过,又或者一条引用在正文中出现了但来源状态异常。这些是格式化工具体验不到的——它们只处理导出前那一步的排版,不处理写作中的来源校验。

格式整理与最终交付。 论文写完不是结束,能交出去才是。Word排版、PDF导出、GB/T 7714-2015参考文献格式化、公式渲染——这些交付环节的知识门槛不低,但它们又是机械的、规则明确的。交给AI处理是合理的,前提是工具本身具备本土化的交付链。

写作主权:一个可以落地的概念

「作者要保留判断权」是一句对的话,但如果不说清楚判断权落在工作流的哪些节点上,它就只是一句口号。

把写作主权操作化,至少对应三个具体节点:

- 改稿节点。 AI提出修改建议时,作者能否逐条看到AI改了什么、为什么改、原文是什么、改动后的文本是什么——然后逐条决定采纳、撤销、还是重新生成。没有diff的AI润色,本质上和「直接覆盖原文」没有区别。

- 引用校验节点。 写作过程中,作者能否随时看到正文引用与资料库之间的对应状态——哪些引用绑定了来源、哪些没有来源(orphan)、哪些来源未被引用(dangling)、哪些状态异常。

- 交付控制节点。 最终导出的Word或PDF,是否包含作者确认过的版本,格式是否可预期,引用列表是否与正文一一对应。交付不是导出按钮按下的一瞬间,而是贯穿写作始终的结构性保障。

InkFount:把上述框架做成工具

以上讨论如果不落在一个具体的工具形态上,容易变成又一篇「辅助可以、代写不行」的泛泛之谈。这里引入InkFount,不是因为它是唯一解,而是因为它的设计思路恰好对应了前述五条标准。

InkFount定位为面向中文研究型写作的AI工作台——注意「工作台」这个词。它不是聊天框里生成论文的工具,而是一个以Markdown稿件为工作现场的平台。AI在稿件内直接改稿,修改以diff形式呈现:作者可以看到原文被删了哪几句、新增了哪几句、AI的依据是什么,然后逐条采纳或撤销。这就是「可审阅的AI改稿」。

引用方面,InkFount在写作过程中把正文引用标记([@alias])与资料库绑定为一个对账系统,支持三种实时状态:bound(正文与来源已绑定)、orphan(正文引了但没有来源条目)、dangling(资料库有但正文未引用)。这意味着参考文献不再是导出前最后一步的格式化问题,而是写作过程中持续校验的来源问题。最终导出Word或PDF时,参考文献按GB/T 7714-2015格式化输出,由系统基于绑定关系生成,而不是让作者手动核对47条引用有没有对错。

模型选择方面,InkFount支持接入多个模型供应商——OpenAI、Anthropic、Google、DeepSeek、Moonshot、阿里巴巴等。这不是单纯堆数量。不同模型在中文长文表达、学术语境理解、上下文长度和调用成本上各有剖面,作者可以根据具体任务选择——润色一段社科论文用某个模型,处理一篇医学综述可能换另一个更合适。这种选择权的意义在于:AI辅助写作不应该被单一模型的能力上限所限制。

Markdown作为主写作入口,是另一个容易被误读的设计。它不是轻量笔记——相反,Markdown的结构化语法让长文的大纲控制、段落层级、引用标记和公式嵌入都在纯文本中保持清晰可读,同时导出到Word、PDF、LaTeX的路径是确定的。对于不具备LaTeX工作习惯的中文研究者,这是降低严肃写作门槛的一种务实方式。

回到那个问题

AI写论文靠谱吗?

如果你的工作流是:丢一个题目进去,等几分钟,下载一篇论文——那答案很明确:不靠谱。不是因为AI写得太差,而是因为这个过程里作者缺席了每一个需要作者在场的节点。

反过来,如果你的工作流是:自己写草稿,让AI在已有文本上做受控润色和结构调整,同时持续对账每一条引用的来源状态,逐条审视AI的改动并决定取舍,最终导出一份引用完整、格式规范的Word或PDF——那么AI不仅靠谱,而且正在帮你省下大量本该花在机械劳动上的时间。

区别不在AI,在工作流。

继续阅读

这些相关文章可以帮助你补齐写作流程中的其他环节。

用 AI 写论文的正确姿势:把它当编辑,而非作者(深度解析 InkFount)

拒绝 ChatGPT 的废话与幻觉。本文解析 InkFount 如何通过精准 Patch 改稿、参考文献对账及多模型工作流,帮助研究者建立“以我为主”的专业 AI 写作体系。

2026年最好用的Markdown编辑器对比:InkFount、Typora、Obsidian、Arya谁最适合写论文?

从论文写作全流程出发,深度对比InkFount、Typora、Obsidian和Arya四款Markdown编辑器的核心差异,帮你找到最适合学术写作的工具。

邪修写综述的正确打开方式:先解决AI「幽灵引用」这道送命题

AI提速综述写作已成趋势,但《柳叶刀》2026年研究显示每277篇新论文就有1篇含幽灵引用。InkFount作为研究级写作工作台,通过参考资料库绑定与引用对账,让AI改稿可溯源、可审查,而非冒险一键生成。

在 InkFount 中实践这套方法

你可以直接在编辑器里搭建提纲、管理参考文献、插入引用,并在导出前完成结构与格式检查。