ChatGPT写的论文一查就露馅?AIGC检测原理与3个降低AI重复率的核心方法

用ChatGPT或Claude生成的学术文本语感出色,却频频被AIGC检测标记。本文从困惑度与突发性两大原理讲起,给出以「人写核心+AI润色+多模型交叉核对」为核心的3个降AI率方法,并推荐InkFount写作工作台辅助落地。

你熬夜把大纲喂给 ChatGPT,它秒回一段学术腔十足的论证,表面看着像模像样。可一提交知网或维普,系统甩回三个字:「疑似 AI 代写」。

这不是你写得不够“学术”,而恰恰是太标准、太顺滑了。降低 AIGC 检测率的根本出路,不是躲躲藏藏搞降重,而是建立「以人为主、AI 为辅」的协作流程:核心观点自己写,用 AI 润色补充,再以多个 AI 模型交叉核对——打乱单一模型留下的模式化痕迹。

AI 写得挺好,为什么一查就露馅?

很多同学想不通:明明自己反复调试了提示词,还把段落改了好几遍,怎么还是被标记?根本原因在于,AIGC 检测不是查“有没有错”,而是查“有多像机器”。

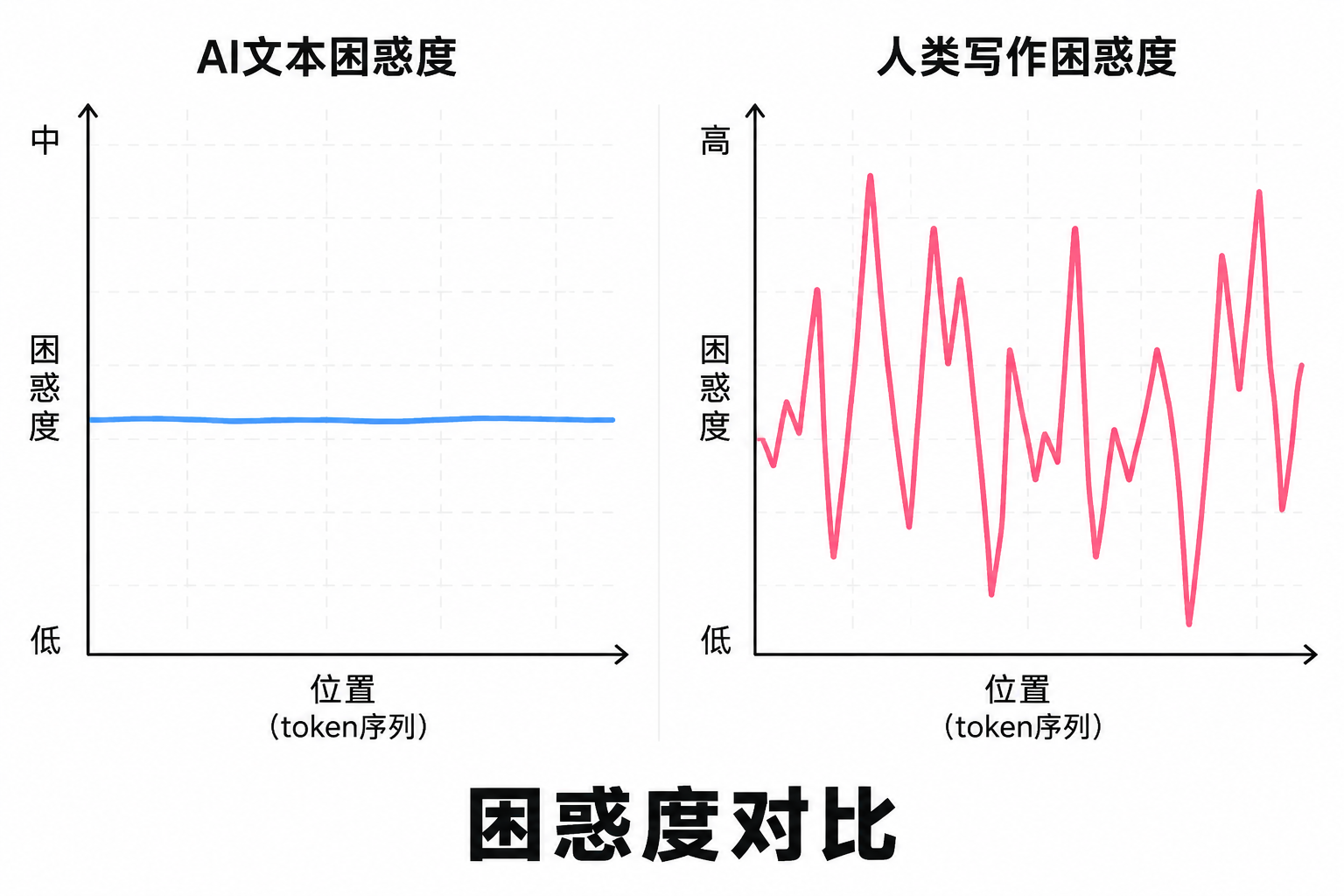

主流检测器背后站着两个硬指标:困惑度(Perplexity) 和 突发性(Burstiness)。困惑度衡量文本的可预测程度——大模型天生倾向于生成概率最高的词串,读起来行云流水,但句与句之间的“信息惊喜”很少。突发性则看句子长短和结构的波动幅度,真人写作常常忽长忽短、忽然跳脱,而 AI 生成的内容均匀得像流水线拧好的螺丝。

说白了,AI 文本的问题不是“写得不好”,而是“太可预测”。查重系统抓的就是这种平滑感。

方法一:核心内容自己写,AI 只做润色和补充

最管用的一招,也是最容易踩坑的一招。不是让 AI 替你从头写到尾,而是你先拿出一版「人味儿」足够浓的草稿——哪怕句子糙一点、逻辑有点跳跃都没关系。

- 你的核心论点、独到分析、实验思路,必须由你亲自码出来。

- AI 的角色退后一步,只负责:理顺语序、修正语法、把啰嗦处删干净,或者在你“卡壳”时给出两三种延伸思路供你选。

这种先人后 AI 的顺序,能最大限度保留文本的突发性,从源头上减少一致性过高的概率特征。我当初写开题报告时,先把研究方法那段用大白话敲出来,再用 AI 逐句润色,最后交给导师一看,他只说“这次逻辑通顺多了”,完全没提 AI 痕迹。

方法二:让多个 AI 模型互相“打架”

单个模型出来的东西,即使改过几十遍,仍可能残留固定的语言指纹。ChatGPT 喜欢用“值得注意的是”“总的来说”,Claude 动不动就“在某种程度上”——检测器认得这些模式。

多模型交叉核对就能打乱统计特征:

- 先用 ChatGPT 润色一段,保存。

- 把同一段原文丢给 Claude,让它换一种说法。

- 你再把两版拼在一起,挑出最像人话的部分重组。

这种“A 模型出草稿、B 模型改写法、人做终审”的混搭流程,会让检测器看到的文本变成杂花生树,难以抓取稳定模式。别嫌麻烦,三五个来回下来,AI 痕迹就碎得看不清了。

方法三:用专业写作工作台把流程串起来——以 InkFount 为例

手动来回切模型、比对版本确实繁琐。我在踩过几次坑后,干脆把流程搬到了 paper.InkFount.com 上。它把前面两件事——精确改稿和多模型回旋——整合在一个工作台里。

- AI 精确改稿:你可以限定只润色不扩写,或者只改写某个段落,避免整段被“AI 化”。

- 引用对账:它会自动核对你插入的文献和文末列表是否一一对应,按 GB/T 7714 规范补全缺漏信息。这对硕博论文特别救命。

- 多模型切换:同一段话,可以一键让不同大模型分别给出改写版,对比起来极度丝滑。

当然,工具只是辅助,核心依然是你写的那堆“人话”。但有个趁手的台子,你至少不用在三个网页间疯狂复制粘贴。

结语:降 AI 率的本质是“人在回路”

别把降 AI 率看成一场猫鼠游戏,它逼着你回答一个更根本的问题:你打算让 AI 替你思考,还是替你打杂?检测系统拦住的,永远是那些把大脑外包的取巧写法。

只要你的核心观点是自己用脑子熬出来的,AI 只是帮你把话捋顺、把格式调规范,那检测结果自然会告诉你:这是个会用人肉脑子的活人。

继续阅读

这些相关文章可以帮助你补齐写作流程中的其他环节。

2026年最好用的Markdown编辑器对比:InkFount、Typora、Obsidian、Arya谁最适合写论文?

从论文写作全流程出发,深度对比InkFount、Typora、Obsidian和Arya四款Markdown编辑器的核心差异,帮你找到最适合学术写作的工具。

邪修写综述的正确打开方式:先解决AI「幽灵引用」这道送命题

AI提速综述写作已成趋势,但《柳叶刀》2026年研究显示每277篇新论文就有1篇含幽灵引用。InkFount作为研究级写作工作台,通过参考资料库绑定与引用对账,让AI改稿可溯源、可审查,而非冒险一键生成。

Claude Code、Codex 与 Cursor 写论文对比:从代码草稿到定稿的完整工作流

本文对比 Claude Code、OpenAI Codex 和 Cursor 在论文写作中的实际表现:它们能快速将代码转化为论文初稿,但缺少参考文献、图表、公式与格式。推荐使用 InkFount 这类研究型 AI 工作台完成定稿,实现引用对账、GB/T 7714 格式导出与 AI 精准改稿。

在 InkFount 中实践这套方法

你可以直接在编辑器里搭建提纲、管理参考文献、插入引用,并在导出前完成结构与格式检查。